――OpenAIのChatGPTをきっかけに、生成AIが大きな注目を集めています。長年AIに携わってこられた立場から、現状をどのように見ていますか。

比屋根 生成AIは、とにかく「すごい」の一言に尽きます。

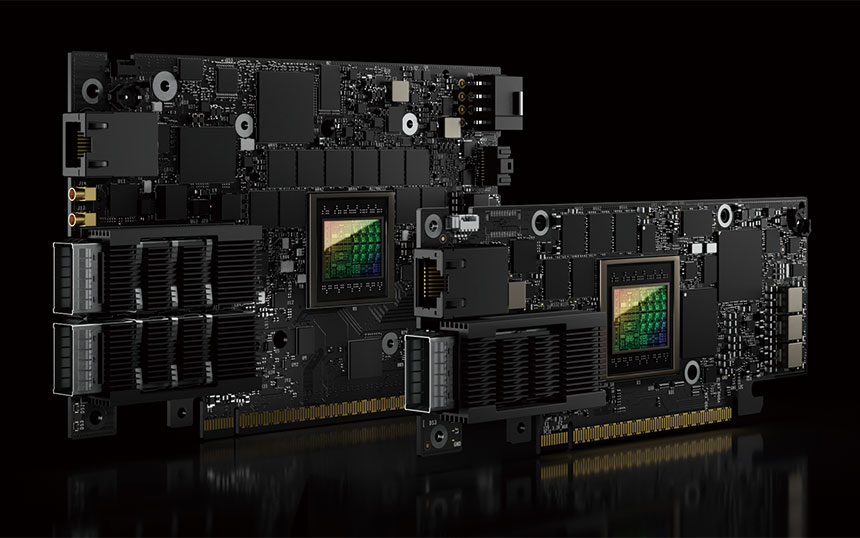

生成AIの基盤となる大規模言語モデル(LLM)は、従来の自然言語モデルと比べて計算量とデータ量、パラメーター数が巨大化することで実現しています。

例えばChatGPTの最新モデルGPT-4は1兆ものパラメーターを使用しているともいわれます。大量のパラメーターで学習できるようになったことでAIは急激に賢くなり、質問に答えたり、翻訳や要約、さらには企画書のネタを考えるなど、今までできなかったアプリケーションが可能になりました。10年に1度の大きな技術革新が起きています。

三菱総合研究所 研究理事/DX技術顧問 比屋根一雄氏

――ChatGPTだけではなく、その対抗馬として名前が挙がるグーグルのBard、アマゾンのAmazon Titanなども米国勢です。生成AIの分野で米国企業が存在感を発揮しているのはなぜですか。

比屋根 これには大きく4つの理由があります。

1つめに、LLMでは大量のデータを処理するため、大規模なクラウドサーバーが必要です。自社でクラウドサーバーを保有し、自由に使えるGAFAMが圧倒的に有利な状況にあります。

2つめに、LLMを開発するにはインターネット上から大量のテキストデータを集めなければなりませんが、世界中のデータの半分以上が英語なので、まず英語から発展するのは自然な流れであるということです。

そして3つめに、米国には世界から優秀な人材が集まりやすく、研究もデータセットや評価基準が整理されている英語の方が明らかに進みやすいという現実があります。

4つめが資金力です。マイクロソフトがOpenAIに100億ドル(約1.3兆円)という巨額投資を行うことが話題になりましたが、これだけの資金力を持っている企業はGAFAMなど一部に限られます。日本企業の場合、100億円の投資も難しいと思います。