アカマイ・テクノロジーズは2025年7月17日、ユーザー向けのセキュリティカンファレンスイベント「Akamai World Tour 2025 Tokyo」を開催した。

アカマイはCDN事業者として知られているが、米Akamai Technologies 共同設立者兼CEOであるトム・レイトン氏は、「現在はサイバーセキュリティとクラウド関連事業が売上の大半を占めている」と話した。

Akamai Technologies 共同設立者兼CEOのトム・レイトン氏

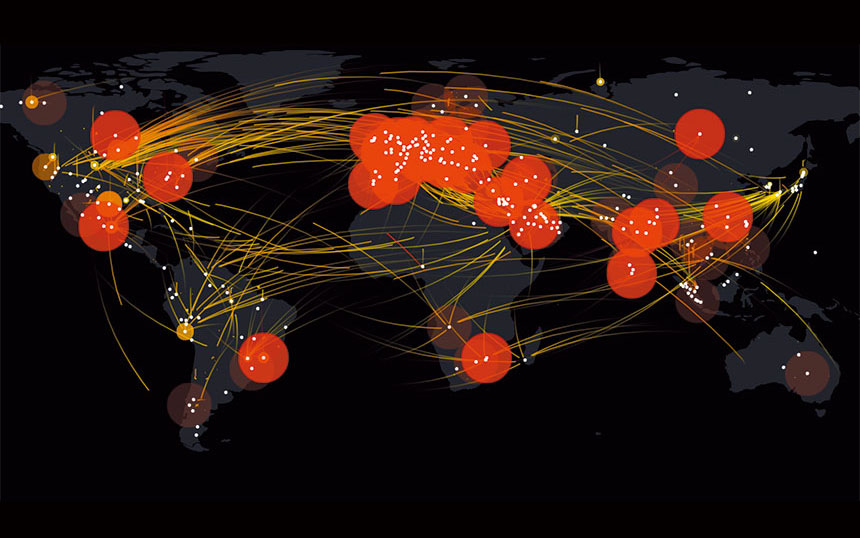

世界中にコンテンツを効率的に配信するため、アカマイは世界130カ国、1200を超える通信事業者やインターネットサービスプロバイダー(ISP)と連携し、4200以上のエッジPoPを展開、約40万台のサーバーを運用している。この「ハイパースケーラーよりも分散した」(レイトン氏)プラットフォームを、DDoS対策やAPI保護、ボット制御など多層的なセキュリティの実行基盤としても活用し、世界中のトップ企業がアカマイのサイバーセキュリティ製品を採用しているという。