業界最高密度「シャーシ型スイッチ1台で640×400G」

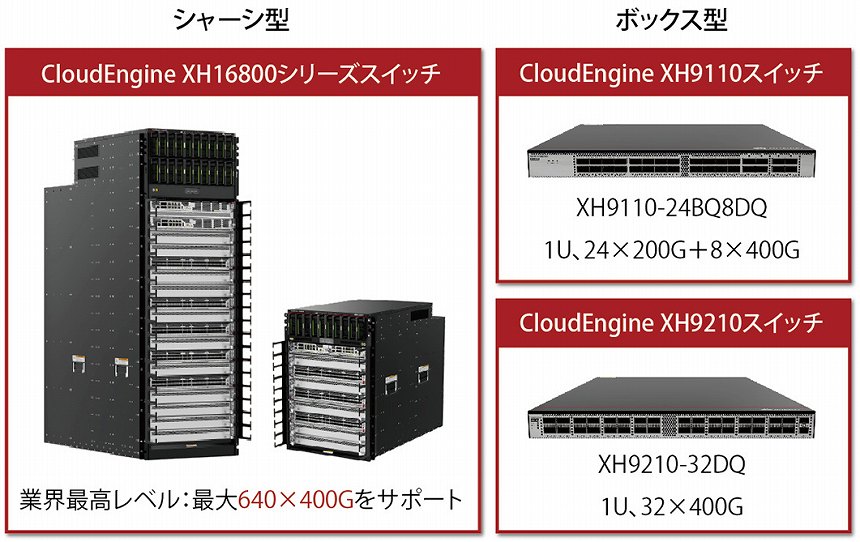

こうした特徴を備える「Xinghe AI」は、スイッチのラインナップも多彩だ。AI開発の規模に応じて最適な製品を選択できる。

ファーウェイXinghe AI 大容量インテリジェントネットワークの製品ラインナップ

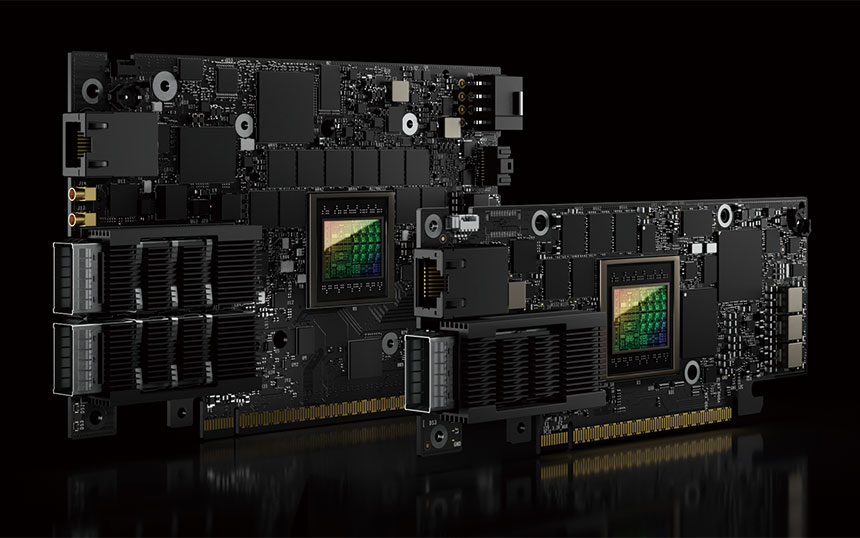

2024年10月現在、提供中のラインナップは上図表の通りだ。シャーシ型スイッチ「CloudEngine XH16800シリーズ」は、400Gを最大640ポート収容可能。「1万基GPU規模に対応可能、業界で最高密度」を誇る製品だ。

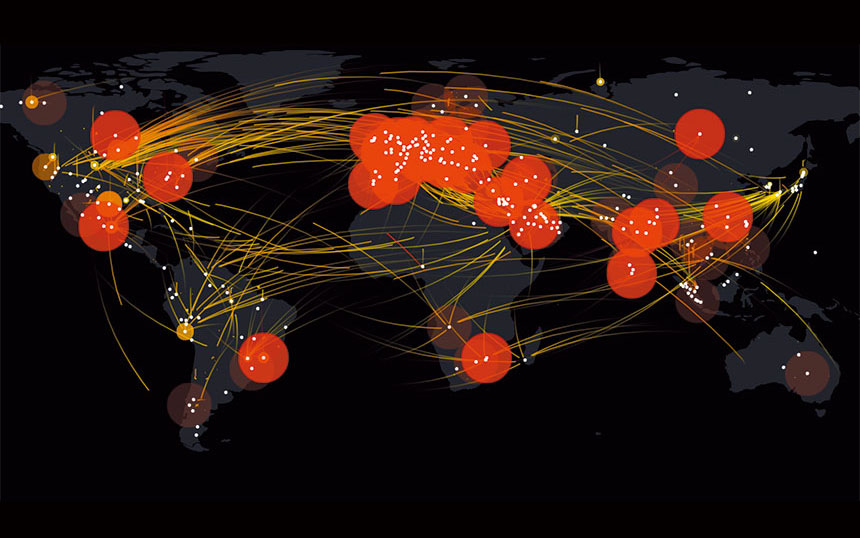

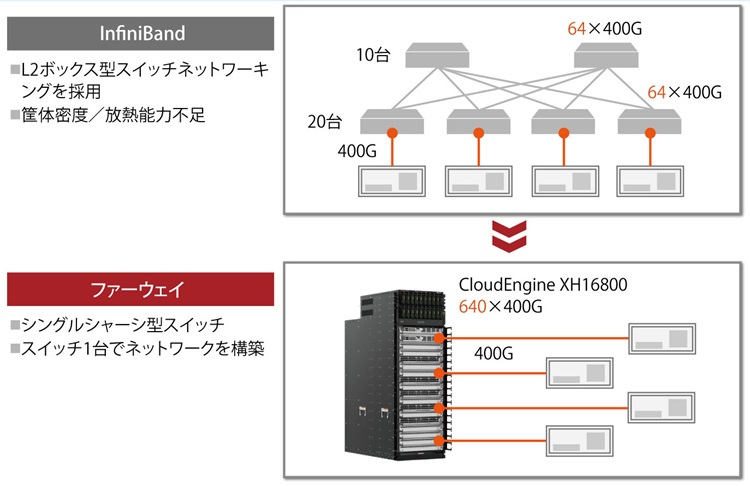

InfiniBandはボックス型スイッチを展開しており、下図表のように数十台のスイッチと、スパイン-リーフ間に多数の光トランシーバーを使ってネットワークを構築しなければならない。導入コスト、運用コストともに高くなる。これは、ボックス型のイーサネットスイッチを採用した場合も同様だ。

InfiniBandとXH16800のネットワーク構成の違い

対して、高密度なCloudEngine XH16800を使えば、上図表のようにシンプルかつ低コストなネットワークを実現できる。競合ベンダーにも400G×576ポートのキャパシティを持つシャーシ型スイッチは存在するが、「それだと1万GPUには足りない。今のところ、このポート密度はファーウェイの方がリードしている」(陶氏)。

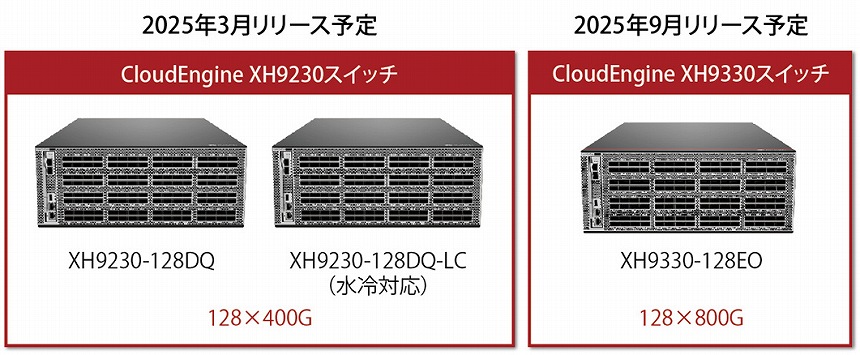

2025年には800G対応のボックス型スイッチも

ボックス型スイッチについては、200G×24ポートと400G×8ポートを備える「CloudEngine XH9110」、400Gを32ポート収容する「CloudEngine XH9210」をラインナップする。数百から数千GPUのネットワークを効率的に構築したり、またはXH16800と組み合わせて、より大規模なAI基盤を構築することもできる。

そして、ファーウェイは先ごろ、2025年にリリースする新製品も発表した。目玉は2つ。初の水冷対応と、800Gのサポートだ。

2025年リリース予定の新ラインナップ(ボックス型スイッチ)

2025年3月にリリースを予定するのが「CloudEngine XH9230スイッチ」。128×400Gと高密度なボックス型スイッチで、水冷対応モデルもリリースする。

もう1つの「CloudEngine XH9330スイッチ」は、800Gに対応(128ポート)。AIネットワークの広帯域化ニーズに応えるもので、2025年9月のリリースを予定している。

AIモデルの大規模化の波は日本国内にも確実に押し寄せている。広帯域かつ信頼性の高いAIネットワークをいかに効率的に作れるかが、勝負を分ける鍵の1つ。ファーウェイのXinghe AIは、AI開発の心強い味方となるはずだ。

<お問い合わせ先>

華為技術日本株式会社

TEL:03-6266-8008

E-mail:nwsupport@huawei.com

URL:https://e.huawei.com/jp/products/switches/data-center-switches