Okta Japanは2026年3月17日、AIエージェントの管理・保護に関する新製品の発表会を開催した。

AIエージェントの利用が急速に広がっている。Oktaが2026年2月に発表した調査によると、世界のITリーダーのうち86%がAIエージェントを自社の戦略において「極めて重要」と回答している。

しかし、課題はその管理だ。同調査では大規模なAIエージェントを管理・統制する基盤を整備しているという回答は27%に留まっている。Okta Japan APJプロダクトマーケティング部 シニアマネージャーの高橋卓也氏は、こうした状況下、「98%の企業が、AIエージェントを管理する機能を持っているかどうかをSaaSの契約更新時に考慮している」と述べた。

Okta Japan APJプロダクトマーケティング部 シニアマネージャーの高橋卓也氏

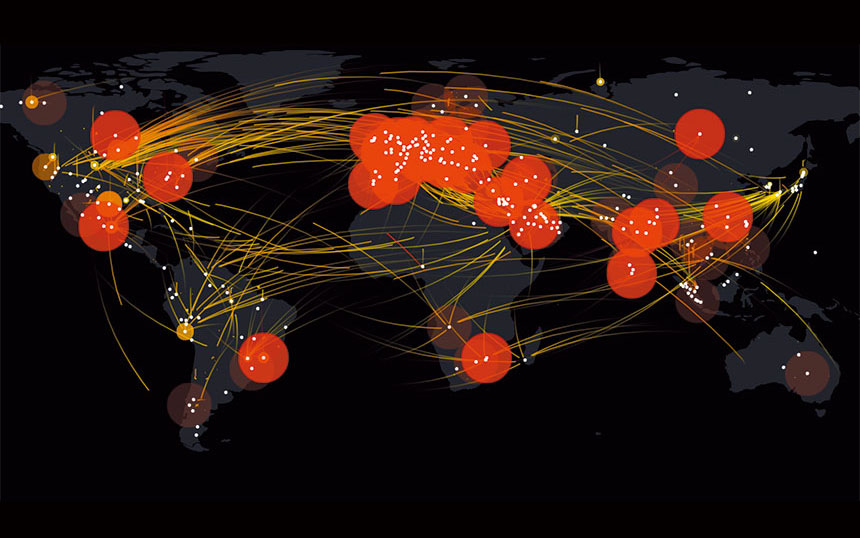

AIエージェントは自律的に動作するため、本来の任務から逸脱したり、予期せず機密データにアクセスしたりというセキュリティ侵害を起こす恐れがある。実際、API管理ベンダーのGraviteeの調査では、88%の組織が疑い事案を含めてAIエージェントによるセキュリティ侵害を報告しているという。

そこでOktaは、企業が安全にAIエージェントを利用するためのフレームワーク「blueprint」を打ち出した。これは、AIエージェントの管理機能を実装するための設計指針で、「AIエージェントがどこに存在するのか、何に接続できるのか、実際に何ができるのか」(高橋氏)の“3本柱”を中心としたものだ。

AIエージェントを“人間同様”に管理する「Okta for AI Agents」

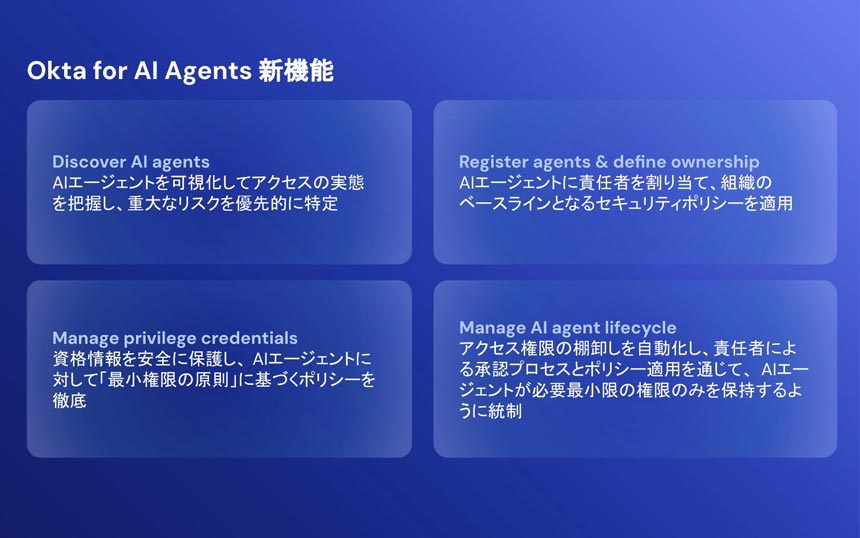

Oktaはこのblueprintに基づいて、アイデンティティ管理をあらゆるユースケースにおいて包括的に行う「Identity Security Fabric」の実現を目指している。そのために開発された製品の1つが、「Okta for AI Agents」である。これは、AIエージェントを独立したアイデンティティとして扱い、可視化(検出)、登録、制御(保護)、統制というライフサイクル全般にわたって管理するという考え方を軸にした機能群からなる。

「Okta for AI Agents」の機能群

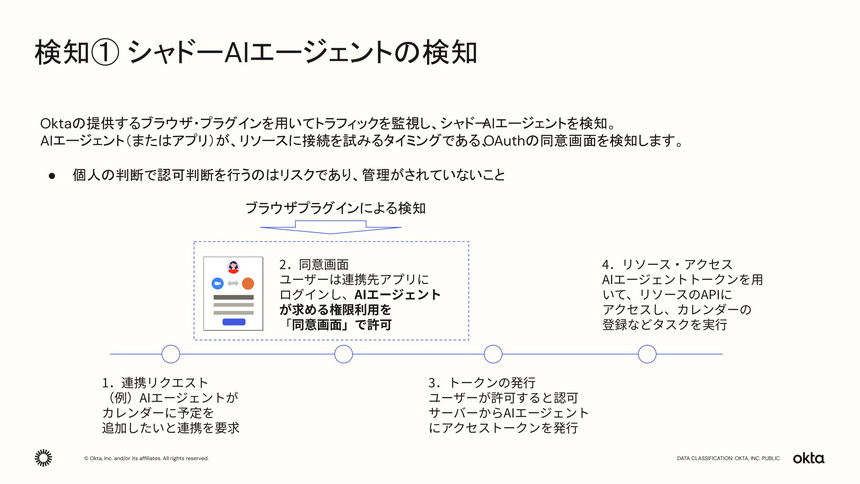

AIエージェントの管理でまず問題になるのが、企業の管理下にないAIエージェントを現場や個人の判断で勝手に用いる「シャドーAIエージェント」だ。管理外のSaaSやツール、また生成AIアプリの利用への対応は以前から課題になっているが、自律的に動作するAIエージェントまで放置すれば、機密情報への不適切なアクセスや情報漏洩などのリスクが高まる。

そこでOkta for AI Agentsは、「Discover AI agents」機能でシャドーAIエージェントを可視化を提供する。従来の境界型セキュリティやアイデンティティセキュリティ製品では管理外のAIエージェントからの接続を検知することが困難だったが、同機能ではHTTPトラフィックを監視し、AIエージェントやアプリがリソースへの接続を試みる際のOAuth同意画面を検知することで、未承認のAIエージェントを発見する。AIエージェントの利用開始段階で管理者に通知することで、管理リストへの登録や是正プロセスにつなげられるという。同日段階では、同機能をブラウザのプラグインによって早期アクセスとして提供開始している。