生成AIの普及が急速に進み、AIエージェントを導入する企業も増えつつある。一方、シスコシステムズによれば、AIに対応できていると自認する企業はわずか13%。その背景には、AI特有のリスクの複雑さがある。

米シスコ AIソフトウェア・プラットフォーム担当バイスプレジデントのDJサンパス氏は「AIのリスクには『セーフティ』と『セキュリティ』の2つの観点で備える必要がある」と指摘する。セーフティとはAIモデルの安全な使用に関わるもので、事実に反する回答を生成するハルシネーションや、有害な出力などが該当する。セキュリティはモデル自体が攻撃対象になることを指し、プロンプトインジェクション(不正操作)や学習データのポイズニングといった脅威が含まれる。

OpenAIやグーグルなどのAIモデルの提供者は、自社のモデルに独自のガードレールを組み込んでいる。しかし、企業では複数のモデルやクラウドサービスを横断的に利用するのが実情であり、あらゆるモデルを一元的に保護する仕組みが求められている。

シスコは3つのアプローチ

こうした課題に応えるためにシスコが提供を始めたのが「Cisco AIDefense(以下、AI Defense)」である。次の3つのアプローチでAIアプリケーションの使用と開発の両面に対して保護を提供しようとしている。

1つめは「AIアプリケーションの発見(Discover)」で、従業員が利用する生成AIアプリや、開発中のシステムにおけるAI活用箇所を特定する。2つめは「脆弱性の検出(Detect)」。攻撃者視点から模擬攻撃を繰り返す「レッドチーミング」により、潜在的なリスクを洗い出す。3つめが「防御(Protect)」で、検出された脆弱性に対し、ガードレールをワンクリックで適用する。このガードレールはOWASP、MITRE、NISTといった標準化団体が規定する200以上の安全性・セキュリティのカテゴリに対応しており、継続的に適用・検証されているという。

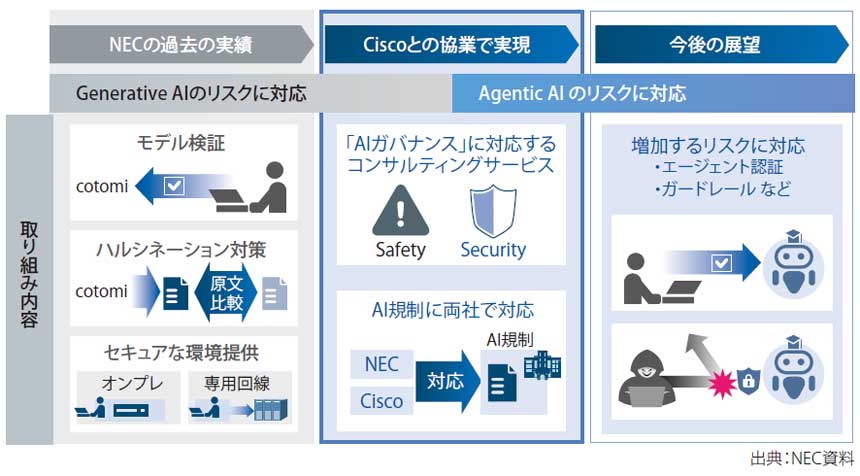

NECはこのAI Defenseとコンサルティングサービスを組み合わせた「AIガバナンスサービス」を2025年秋に開始する(図表1)。「高度なAIリスク管理を『AIガバナンス』と呼んでいる」(NEC Corporate SVPの山田昭雄氏)という。

図表1 シスコとNECによるAgentic AIのリスク対策

山田氏によれば、AI技術の進化に伴いリスクも変化している。顔認識に代表される「コグニティブAI」は、基本的に閉じたシステムで運用するためそのリスク範囲は限られている。しかし、クラウド基盤で稼働する生成AIは外部ネットワークを経由するため、意図しない情報漏洩のリスクが常に伴う。さらに今後普及が見込まれるAIエージェント(Agentic AI)は、自律的な業務遂行のため、社内システムと深く連携する。その結果、セーフティ面に加え、AIを通じた社内システム攻撃の可能性というセキュリティ面のリスクが高まることになる。

AIガバナンスサービスはこうした時代の到来を見据えたものだという。NECのAIソリューション群「BluStellar」の一環として位置づけられている同サービスは、システム導入前の段階からシスコのテクノロジーを活用しリスク評価を行い、セキュアな環境の提供からAIエージェントの正当性を確認するエージェント認証に至るまで、AI運用のライフサイクルを一貫して支援するというものだ。「AIを活用する顧客の不安を払拭するキーパーツとしてAI Defenseを活用していく」(山田氏)