NTTドコモとNTTは2026年3月2日、分散配備された遠隔GPUリソースと5GネットワークをIOWN APNで接続するINCエッジを活用したIn-Network Computingにより、低遅延なAI映像解析の実証実験に成功したことを発表した。

本実証実験では、5Gコアネットワーク上に実装したINCエッジにより、通信の制御に加えてAI推論処理をネットワーク側で制御した。これにより、IOWN APNを介して接続された遠隔GPUリソースを用い、端末から転送された映像データを低遅延に解析できることを確認。6G時代の遠隔でのロボット制御に十分な低遅延を実現できる見通しを得たとしている。

AI推論処理の分散実行は、従来、アプリケーションやサーバー側で制御されることが一般的であり、ネットワークは主にデータ転送を担う役割にとどまっていた。そのため、推論処理に用いるGPUリソースの配置や通信遅延がサービス品質に大きく影響し、通信遅延の面で有利である地理的に近い場所にある計算リソースの利用が前提となるなど、柔軟なリソース活用には課題があった。

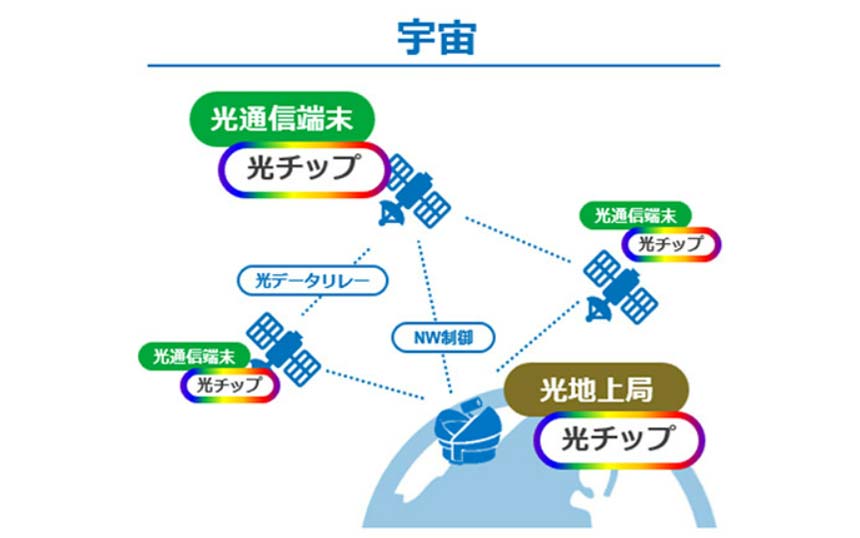

ドコモとNTTはこの課題の克服に向けて、6G時代のネットワークに必要な要素技術として、INCの研究開発を進めている。INCでは、ネットワークの中にGPUをはじめとしたさまざまなリソースを分散配備し、通信だけではなくサービスの計算処理もネットワークで制御することで、AIなどのサービスを高品質で提供する。

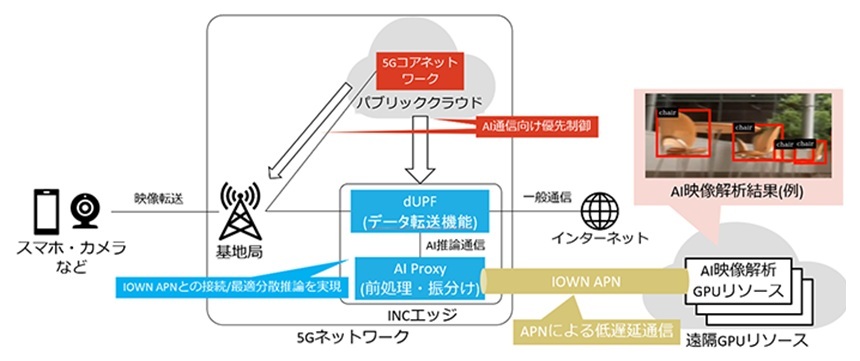

実証実験のシステム構成

今回の実証実験では、ネットワーク内に分散配備された遠隔GPUリソースと5GネットワークをINCエッジを用いてIOWN APNを介して接続。5Gネットワークに接続された端末から送信された映像データのAI推論処理の検証を実施した。

AI推論処理を分散実行するケースでは一般的に、同一拠点内など地理的に近い場所にあるGPUリソースの利用が前提とされているが、本実証実験では、INCエッジとIOWN APNを活用し、通信の制御に加えてAI推論処理をネットワーク側から制御。これにより、地理的に離れた遠隔GPUリソースを用いた場合でも、高い推論性能を維持できるかを検証した。

また、INCエッジとして、新たにIOWN APNとモバイル網の接続機能に加え、AI推論処理を推論の前段にあたる処理と推論の実行部分に分け、前段処理後のデータを遠隔GPUリソースへ低遅延に転送・振分けするための仕組みをネットワーク機能として実装。映像データの転送には、AWS上に構築した商用5Gコアネットワークの優先制御機能を適用し、INCエッジの役割と組み合わせることで、5GネットワークおよびIOWN APNを活用した広帯域・低遅延なAI映像解析を実現した。

今回の実験において、通信とAI映像解析の合計処理遅延は、人間の周囲でロボットが自律制御に基づいて動作する場合に想定される要求遅延と比較して、要求遅延以内であることを確認。6G時代の遠隔でのロボット制御に十分な低遅延を実現できる見通しを得たという。