東京大学大学院工学系研究科(以下、東京大学)、NEC、NTTの3者は2026年2月26日に記者説明会を開催し、AIエージェントと6G/IOWN基盤技術を用いたリアルタイムAR(拡張現実)支援の実証に成功したと発表した。

具体的には、ARグラスを装着したユーザーの周辺環境をAIエージェントが継続的にモニタリングし、環境変化などを把握したうえで、潜在的なリスク兆候をリアルタイムに予測・判断できるか検証した。

実証の概要

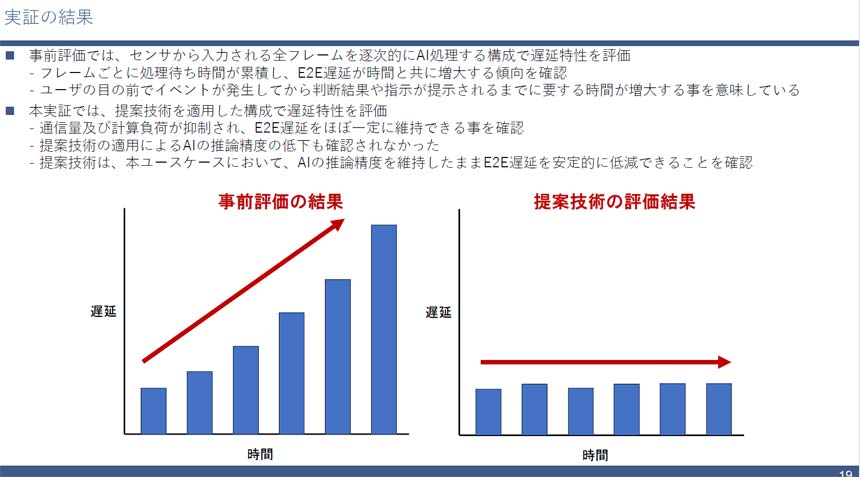

東京大学の海田圭太氏によれば、取得した映像データを逐次AI処理する構成では、処理待ち時間がフレームごとに蓄積し、エンドツーエンド(E2E)遅延が増大するという問題点があった。これに対し、今回3者が提案した技術を用いることで、AIエージェントの推論精度を維持したまま、E2E遅延を大幅に低減できることを確認したという。

実証の成果

東大の「意味の差分のみを伝送する」独自技術

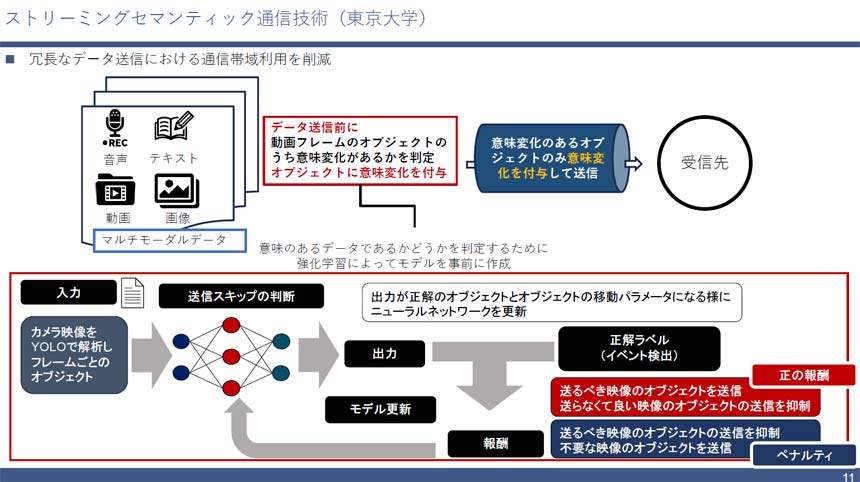

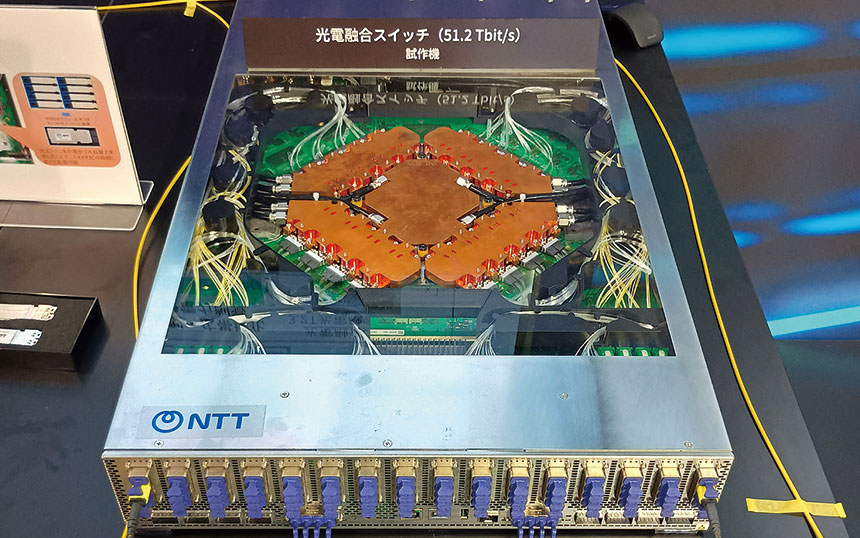

この遅延低減に寄与したのが、東京大学が開発した「ストリーミングセマンティック通信技術」、NECの「生成AI向けメディア制御技術」、NTTの「In-Network Computing(INC)技術」という3技術である。

1つめのストリーミングセマンティック通信技術は、データをそのまま送るのではなく、「意味的に重要な情報」だけを抽出・圧縮して送る「セマンティック通信技術」を応用したものだ。東京大学の小野翔多氏によると、ストリーミングセマンティック通信技術は、「周囲の状況変化を検知したうえで、意味の差分のみを伝送することができる」。

多数のセンサー等から膨大なデータが常時送信されると、無線区間で十分な通信帯域を確保することが難しくなるが、同技術を活用することで、こうした課題を解決できるとした。