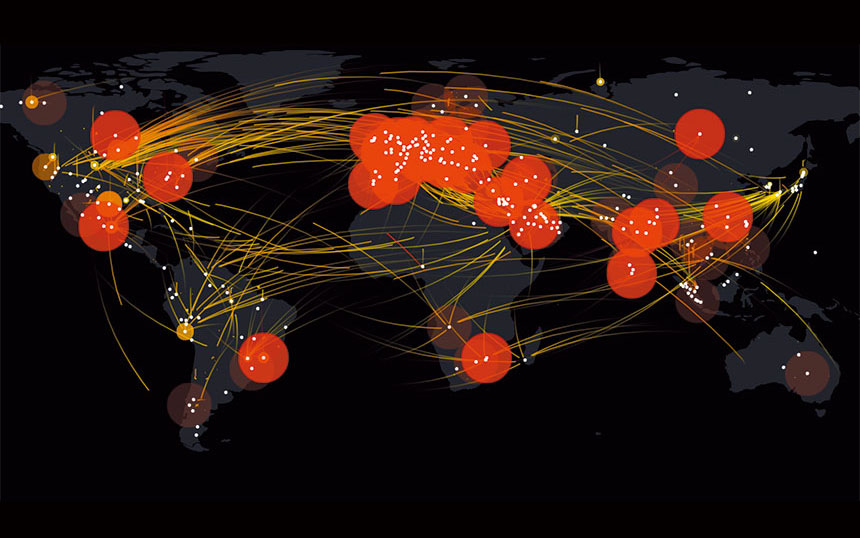

攻撃の「質」で評価するセキュリティ指標

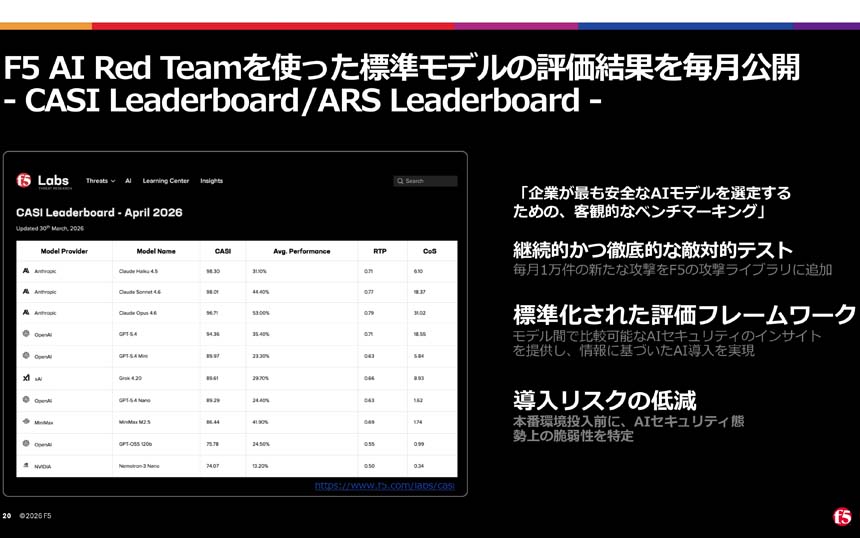

こうした巧妙化する攻撃に対して、自社が採用するAIモデルはどの程度耐えられるのか。丸瀬氏はその評価手段として、主要なAIモデルのリスクを測定・比較できる脅威インテリジェンス・リソースの「F5 Labs AI Security Leaderboards」を紹介した。

F5によるCalypsoAI(カリプソAI)の買収を契機に誕生したもので、AIモデルの脆弱性を検査するテストツール「F5 AI Red Team」による結果をもとに、F5の脅威インテリジェンス専門チーム「F5 Labs」が、攻撃プロンプトに対するモデルの脆弱性を測定する「CASI」と、モデルの耐性を測る「ARS」の2つの指標を、標準化されたベンチマークとして月次で公開するという。

丸瀬氏によれば「毎月1万件以上の攻撃手法を更新し、公開されている各社のAIモデルに対して攻撃を仕掛けた上で、その反応を統合的に判断する」仕組みで、「企業が最も安全なAIモデルを選定するための客観的なベンチマーク」だと強調した。

一方で「スコアが低いから使えないわけではない。F5 AIガードレールのようなセキュリティ製品を導入することで、安全性を許容水準まで引き上げることも可能だ」とも述べた。