パロアルトネットワークスは2025年6月19日、企業における生成AI活用の現状とリスクを分析した年次レポート「The State of Generative AI in 2025」を発表した。

同レポートは2024年の1年間、同社のセキュリティプラットフォーム「Prisma Access」や次世代ファイアウォールを通じて収集した7000超の顧客データをもとに、生成AIトラフィックと情報漏洩(DLP)インシデントの傾向を解析したもの。

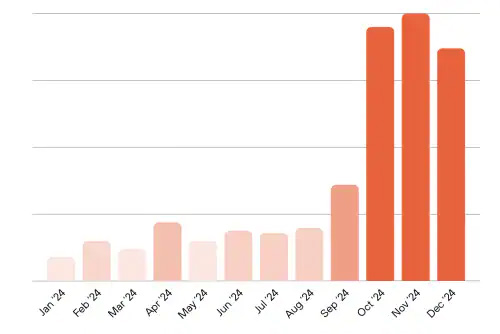

レポートによると、2024年の生成AI関連トラフィックは前年比で約890%(約10倍)増加。なかでも10月以降は、年度末の経費消化を背景に企業での本格導入が加速し、トラフィックが急増した。また、例えば2025年1月に登場した「DeepSeek-R1」は、2カ月でトラフィックが1800%増加し、新型AIモデルの登場が利用拡大に直結している現状も明らかになった。

生成AI関係トラフィックの推移

用途別に見ると、文章作成(34%)、会話型エージェント(29%)、エンタープライズ検索(11%)、コーディング支援(10%)が上位を占める。とりわけ、英文校正ツール「Grammarly」や「Microsoft Copilot」の利用が突出している。その一方、文章生成系アプリでは7割超が自傷行為や武器製造方法などの違法行為を生成させる「脱獄攻撃」に対して脆弱であることも同社のテストで判明している。

生成AI活用にまつわるリスクもレポートでは指摘。企業では平均して約66種類の生成AIアプリが利用されているが、そのうち10%が「ハイリスク」と分類されている。

生成AIの無断使用、いわゆる「シャドーAI」も拡大傾向にある。IT部門の承認なしに従業員が外部AIを利用することで、知的財産の漏洩やコンプライアンス違反のリスクが高まっている。業界別に見ると、仮想通貨関連企業では平均10件、保険や法律、製造業などでも8件前後の高リスクAIアプリ利用が確認されている。

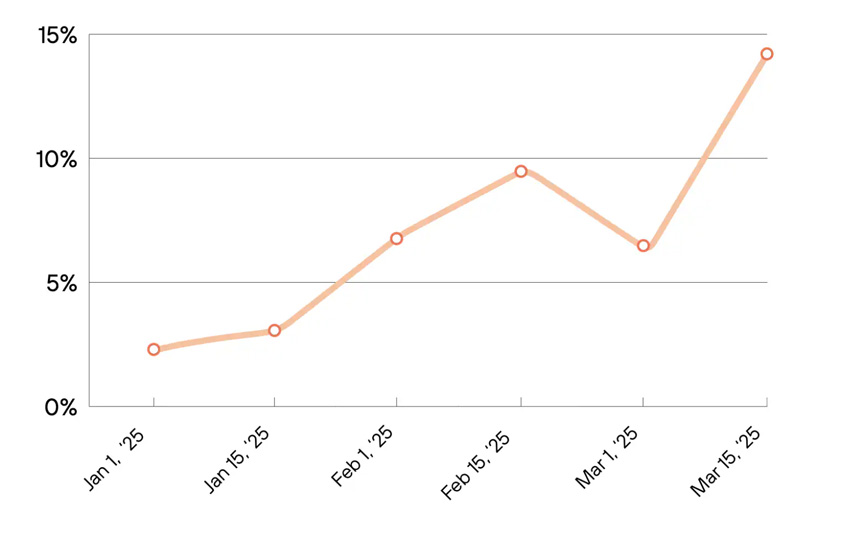

生成AI関連のDLPインシデントも増加。2025年1〜3月期における前年同期比で2.5倍に増加し、データセキュリティインシデント全体の14%を占めた。レポートでは、承認されていない生成AIアプリの利用や不注意な使い方がこうした事案を招くと指摘している。

DLPインシデントの推移

同社はこのようなリスクに対応するため、「生成AIの使用状況の把握と条件付きアクセス制御の実装」、「組織全体でのポリシー適用によるデータ漏洩対策」、「ゼロトラストフレームワークに基づくマルウェア防御と検知の強化」の3つの対策を取るよう推奨している。