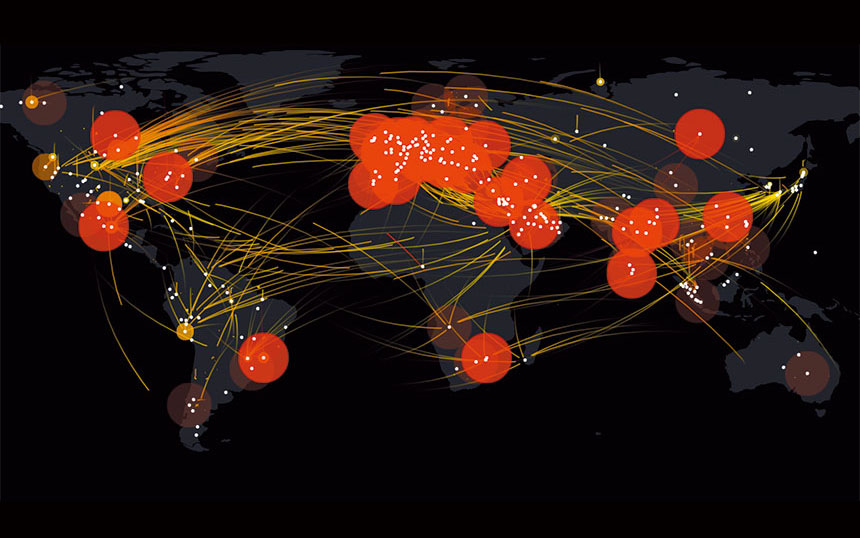

生成AIによる個人情報漏えいのリスク

「AI/機械学習の応用で社会に貢献したい」

入社前に思い描いていた通りの仕事が現在できているという芝原。その一方、AI/機械学習をめぐる状況は、入社から9年あまりの間で劇的に変化した。生成AIが大きな衝撃を与えるなど、AIによって社会が大きく変容し始めている。

そのため、芝原も新たな挑戦を始めている。生成AIのセキュリティ――生成AIによるプライバシー侵害を防ぐための研究に現在注力している。

その内発的動機はこうだ。

「今、私たちの様々な情報が、GAFAに代表される大手IT企業に蓄積されています。こうしたデータが自分の利益のために活用されるのはいいことですが、自分の情報が漏えいしたら……。プライバシーは個人的に一番気になることでした」

芝原の研究テーマの1つは、「メンバーシップ推定攻撃」である。生成AIから個人情報のような機微情報が漏えいするリスクがないかを評価できるという。

「機械学習には、学習に使われた教師データをモデルが記憶してしまうリスクがあると指摘されています。もし、モデルが個人情報を記憶していると、生成AIから漏えいしてしまう可能性があります」

例えば、教師データの中に、住所やクレジットカード番号の情報が含まれていたとしよう。そして、生成AIが記憶したままだったとすると、生成AIの出力結果の中に、個人の住所やクレジットカード番号の特定につながる情報が含まれる可能性が残ることになる。

「メンバーシップ推定攻撃では、教師データに『含まれているデータ』と『含まれていないデータ』を用意して入力し、出力結果からどちらか判定できるかを評価します。そして、高精度に判定可能な場合は、そのモデルは教師データを記憶しており、『危ない』と評価することができるのです」

インターネットの普及により、世の中は圧倒的に便利になった。だが、その恩恵を安心して享受するためにはセキュリティソリューションが不可欠である。

生成AIについても同様、セキュリティソリューションが安全な利用のために必要になると芝原は見る。

NTTは、独自開発した大規模言語モデル(LLM)「tsuzumi」を活用したサービスを2024年3月に商用化する予定だ。「将来、tsuzumiにも自分の研究成果を活かすことができれば」と芝原は抱負の1つを語る。

信頼できる生成AI時代を目指して、芝原の内発的動機は今、大きく高まっている。

<お問い合わせ先>

NTT社会情報研究所

URL:https://www.rd.ntt/sil/