NTTドコモビジネス(旧NTTコミュニケーションズ)は2025年7月2日、秘密分散技術を活用した法人向けクラウドストレージ「析秘(せきひ)STORAGE」の提供を開始した。

AIやIoTなどのデジタル技術の進展により、業務において生成されるデータ量は急増している。こうしたデータには企業活動の根幹に関わる機密情報が多く含まれるが、激甚災害やサイバー攻撃に備えたデータのバックアップ対策は、大企業と中小企業で差があるのが実状だ。

NTTドコモビジネス ビジネスソリューション本部スマートワールドビジネス部 スマートヘルスケア推進室 担当部長の櫻井陽一氏は、「中小企業はBCP策定のリソースや専門知識が不足している」と指摘し、今回発表した析秘STORAGEがその対策になることを説明した。

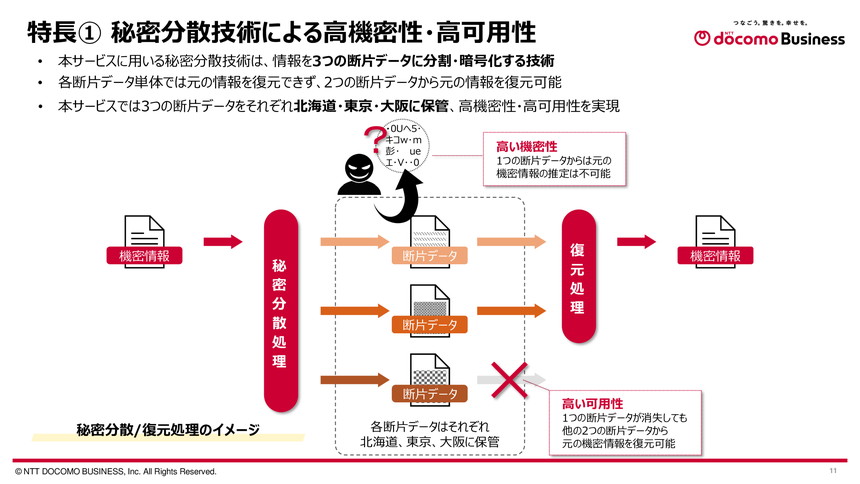

析秘STORAGEの大きな特徴は、秘密分散技術を利用し、保存データの機密性と可用性を高めた点だ。同サービスの秘密分散技術は、情報を3つのデータに分割・暗号化するもの。これにより、1つの断片データから元の情報は復元できない一方で、2つの断片データがあれば復元が可能になる。

同サービスは、この3つの断片データを3拠点に自動で分散保存する。ドコモビジネスは北海道、東京、大阪の各地に拠点を設置し、1つの拠点が災害などで停止した場合でもリアルタイムで復元が可能という。

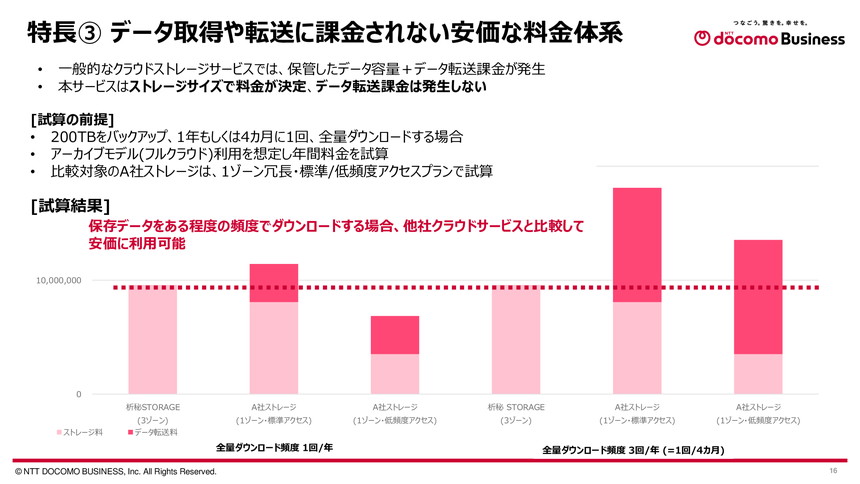

また、低コストも特徴だ。「一般的なクラウドストレージサービスは保管したデータ容量に加えデータ転送量に課金されるが、析秘STORAGEはデータ転送料金が発生しない」(櫻井氏)。保存したデータを年3回などある程度の頻度でダウンロードする場合、他社サービスと比較し安価に利用可能になるという。

クラウドサービスの利点を活かしシステム運用負荷を低減することに加え、利用しやすいインターフェースを備える。エンドユーザー向けにはWeb UIを提供し、ドラッグ&ドロップでファイル操作が可能なほか、Amazon S3互換のRestAPIを具備し、CUIでの操作にも対応する。