2030年に644万人もの労働力が不足し、約22兆円のGDPが失われるという悲観的な未来が示されている日本。この問題は我が国だけでなく、多くの国が今後直面することになる。

これを解消する切り札の1つと目されているのが、デジタルヒューマンだ。ECサイトやメタバースで接客や商品説明、問い合わせ対応を担う“デジタル社会の住人”を目にしたことのある人も多いだろう。

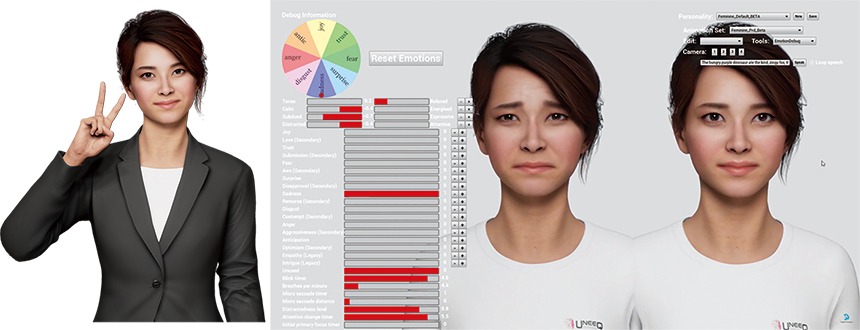

デジタルヒューマンは人が操るアバターとは異なるものだ。定義はまだ明確でないが、多くの用例に共通する要素は「CGによるリアルな人間の外見を備え、AI技術を使った対話が可能で、感情表現を再現できる」といったものだ。

もちろん意思は持たないが、対話相手からは自律的に動いているように見える。AIを擬人化したものと言うことができ、表情や声、仕草を組み合わせることで、AIチャットボットよりリッチかつ自然なコミュニケーションを可能にしている。

デジタルヒューマンは、生成AIを核として多様な技術要素を駆使したものだ。かつ、世界的な労働力不足を背景に高い需要が期待できることから、急速な市場拡大が見込まれている。Emergen Researchは2024年以降、34.2%という驚異的な成長率で市場規模が拡大し、2032年に5611億ドルに達すると予測。ガートナーは、世界を変える可能性があるテクノロジ・ディスラプションの1つに挙げ、「あらゆる分野で人間同士のやりとりに取って代わる可能性がある」と予想している。

人間とデジタルヒューマンのコミュニケーションは、会話を音声認識してテキストに変換し、クラウド上の生成AIが処理、その応えを音声合成して返すというのが基本的な仕組みだ。三菱総合研究所 生成AIラボの飯田正仁氏によれば、そのコミュニケーションは次の4つの要素で構成されるという。

①LLM(大規模言語モデル)や音声モデルで構成される対話システム、②表情や声のトーン、リズム等による感情表現、③あたかも自律的に反応しているように見せる応答システム、そして④CGによるリアルな外見だ。これらの要素が組み合わさることで、人間のようなコミュニケーションを可能にしている。

対話能力は、ChatGPTの登場後に大きく進化した。連続的に自由な受け答えが可能になったことで用途が広がったが、今後は対話相手の思考や感情の推測、人の思考の支援が可能な段階へと進化することで、さらに活躍の場が広がるだろう。

感情を扱う技術は、Affective Computingと呼ばれる。顔画像や音声を解析して人の感情を認識することから発展したもので、広告やコールセンター、ヘルスケアなどの領域で検討されている技術だ。デジタルヒューマンでは相手の感情認識に加えて、表情や声のリズムで感情を表現するのにも使われる。

人間のような自然な応答を実現するCGアニメーションの作成には、ゲームエンジンのUnityやUnreal Engine等の技術を活用している。こうしたコア要素に加えて、デジタルヒューマンを運用するには、Webサイトやメタバースとの連携・制御、画像認識、対話相手の感情推定、有人チャットサービスとの連携など様々な機能が必要となる。